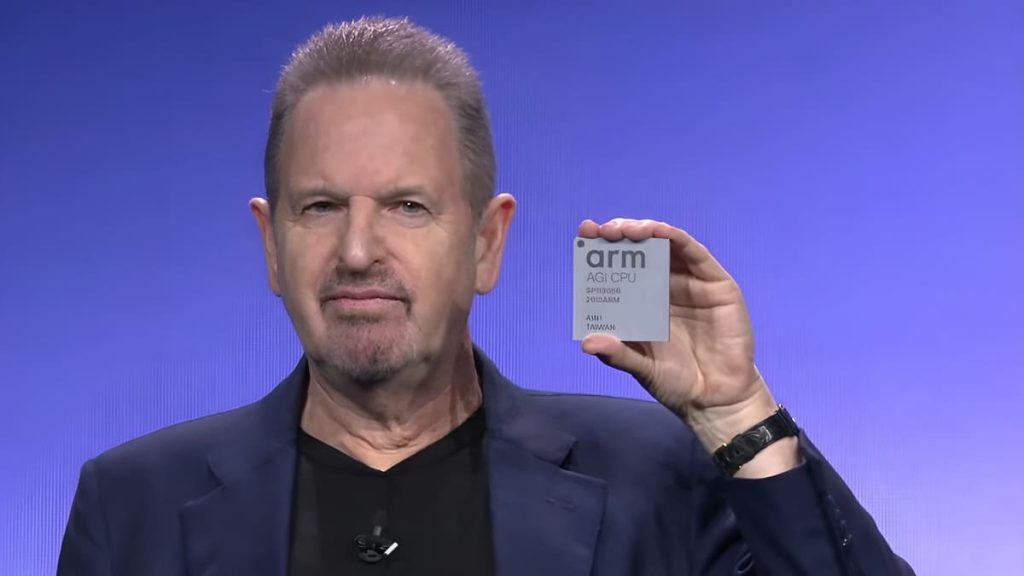

Arm ha presentado su primer chip de fabricación propia, una medida que podría afianzar la posición de este pionero de los semiconductores en los centros de datos de IA y redefinir el papel del Reino Unido en el ecosistema de la IA.

La CPU Arm AGI no compite con la potencia de cálculo bruta de las unidades de procesamiento gráfico (GPU) de fabricantes como AMD y Nvidia, pero el chip actúa como un orquestador, programando las acciones de los agentes de IA, gestionando el funcionamiento de los aceleradores de IA y supervisando los sistemas de memoria y almacenamiento en un centro de datos.

Los CPU´s vuelven a estar en auge

Si bien 2023 y 2024 se caracterizaron por una enorme demanda de GPU, en los años posteriores la atención se ha centrado en chips más especializados. Los circuitos integrados de aplicación específica (ASIC) están en auge: Google cuenta con unidades de procesamiento tensorial (TPU) , Amazon con Trainium e Inferentia , Microsoft con Maia y Meta con los aceleradores Meta Training and Inference Accelerator (MTIA).

Para las grandes empresas de computación en la nube, tiene sentido adoptar estos chips además de (o en lugar de) las GPU de terceros para lograr una inferencia de IA más eficiente a gran escala. Google, por ejemplo, optimizó TPU v7 Ironwood para obtener el mejor costo por token con sus modelos de IA Gemini y para lograr mejoras masivas en el rendimiento.

Sin embargo, Arm no se está adentrando en este mercado. En cambio, se ha labrado un nicho perpendicular a tecnologías como las GPU y los ASIC, con una CPU diseñada para marcar el ritmo de las cargas de trabajo de los agentes de IA, independientemente del hardware que utilicen para el procesamiento.

De hecho, la empresa está apostando fuerte por las CPU, ideales para el procesamiento secuencial necesario para la gestión de cargas de trabajo. Arm ha sido durante mucho tiempo la potencia de diseño detrás de las arquitecturas de chips móviles más importantes del mundo, que licencia a empresas como Apple, Google, Microsoft, Nvidia, Samsung e Intel.

Según Reuters, el potencial financiero es evidente, Arm prevé unos ingresos anuales de 15.000 millones de dólares en los próximos cinco años. Al ser una empresa con sede en el Reino Unido, una buena parte de estos ingresos se destinará a impuestos, nóminas e inversiones adicionales en dicho país.

Especificaciones de la CPU Arm AGI

Arm afirmó que la CPU AGI ha sido optimizada para cargas de trabajo agenciales de alto rendimiento y procesamiento masivamente paralelo que se ejecutan en racks de servidores de alta densidad.

Para ello, el chip está equipado con hasta 136 núcleos Neoverse V3 de Arm a una frecuencia de 3,7 GHz, con 2 MB de caché L2 por núcleo y una latencia de memoria inferior a 100 ns.

La configuración de referencia del servidor Arm para la CPU AGI es un diseño de 1OU y 2 nodos con dos CPU AGI por blade. Ampliado a un rack de 36 kW con 30 blades, esto permite 8160 núcleos Neoverse V3 por rack.

La empresa también ha colaborado con Supermicro en un diseño de rack de 200 kW con refrigeración líquida, capaz de albergar 336 CPU AGI, para un total de más de 45 000 núcleos. Arm afirmó que esta configuración ofrece un aumento de rendimiento estimado del doble en comparación con las últimas opciones x86.

Competirá directamente con la CPU Vera de Nvidia, basada en Arm, que también gestiona la capa de orquestación para el despliegue de agentes de IA a gran escala. Arm afirma que su chip ofrece un ancho de banda de memoria de 6 GB/s por chip, mientras que el de Nvidia alcanza los 14 GB/s. El primero incorpora memoria DDR5 de 12 canales, frente a la LPDDR5X del segundo.

En definitiva, esto va más allá de las especificaciones técnicas. La ventaja de Arm reside en su diseño abierto: gracias a la interconexión Compute Express Link (CXL) 3.0 Tipo 3 y la memoria DDR5, la CPU AGI puede combinarse con una gama mucho más amplia de hardware que la CPU Vera, optimizada para sistemas Nvidia.

Arm también ha rechazado el procesamiento multihilo, en el que los núcleos de la CPU ejecutan varios hilos simultáneamente. Mohamed Awad, vicepresidente ejecutivo de IA en la nube de Arm, declaró a The Register que esto se debe a la necesidad de mantener un rendimiento determinista.

En otras palabras, Arm apuesta a que sus clientes se beneficiarán más de un rendimiento predecible y sostenido a la hora de orquestar agentes de IA, en lugar de las fluctuaciones de rendimiento que ofrece el procesamiento multihilo. Dado el interés inmediato de los clientes , pronto veremos esta teoría puesta a prueba.

Socios ya establecidos

Antes del anuncio, Arm consiguió un importante compromiso con Meta para el despliegue del nuevo chip. Arm describió a Meta como su «socio y cliente principal» y afirmó que la compañía busca utilizar la CPU AGI para dar soporte a sus centros de datos a escala de gigavatios junto con los aceleradores MTIA.

Esto podría interpretarse como un importante voto de confianza, dado que Meta se esfuerza por alcanzar a sus competidores en el ámbito de la IA . Al elegir la solución de Arm, junto con su propio hardware, Meta ha asegurado miles de millones de dólares en ingresos para Arm, al tiempo que refuerza los argumentos del diseñador de chips de que su producto está a la altura de la tarea de gestionar agentes de IA a nivel de hiperescalador.